DeepFakes y desinformación: el reto de detectar audios ‘falsos’ en un proceso electoral

¿Qué tienen en común el cantante Bad Bunny, la activista Gretta Thunberg y el presidente de Rusia Vladimir Putin? Todas escucharon su propia voz en una grabación que nunca hicieron, resultado de una clonación con Inteligencia Artificial (IA).

Eso fue lo que argumentó Martí Batres, jefe de Gobierno de la Ciudad de México, luego de que se le atribuyó un audio en el que supuestamente se dieron instrucciones para manipular el proceso interno de Morena, para definir la candidatura del partido guinda en la capital del país. “Está producido con inteligencia artificial. No es real”, dijo Batres.

En ese caso no se pudo determinar con certeza si el audio fue efectivamente creado con IA. Herramientas como AI Voice Detector no dieron un resultado concluyente, pues al analizar diferentes fragmentos del mismo audio el porcentaje de probabilidad de que fuera hecho con IA variaba desde un 26% hasta casi un 70%.

Para probar la herramienta grabamos un breve audio con nuestra voz natural. Nosotras estábamos seguras de su autenticidad, pero para la herramienta había un 55% de probabilidad de que fuera hecho con IA.

Pese a la evolución de las tecnologías de detección “siempre va a haber un componente de tasa de error”, advierte Manel Terraza, quien es CEO y fundador de loccus, una startup dedicada a la detección de voces sintéticas.

Algunos especialistas en audio señalaban que aspectos como la pronunciación, la entonación y las pausas para respirar eran muestra de que el audio que se atribuyó a Batres no fue hecho con IA; pero para otras personas esos mismos elementos eran prueba de que el audio fue creado con tecnología y no pronunciado por el jefe de gobierno.

De hecho, las autoridades de la Ciudad de México dedicaron varios minutos de una conferencia de prensa para demostrar lo sencillo que es recrear un audio con tecnología por menos de “200 pesos al mes”. Este mismo ejercicio fue replicado por usuarios de X, antes Twitter, que una y otra vez crearon audios donde una voz similar a la de Batres confiesa cosas, en algunos ejemplo con acento extranjero.

Pese a ello, su difusión en redes sociales volcó la conversación en torno a la posible división dentro del mismo partido, todo ello días antes de que concluyera este proceso preelectoral.

El audio de Batres también hizo evidente que el mal uso de la inteligencia artificial en procesos electorales puede dar lugar a la desinformación y la manipulación del discurso público. Algo que en otros países como Venezuela, Colombia y Estados Unidos ya han experimentado en sus más recientes elecciones.

En este sentido, verificadores como Cazadores de FakeNews en Venezuela o Colombia Check ya han descrito que determinar si un audio es real o falso no es tan sencillo y requiere de la combinación de elementos tecnológicos, pero sobre todo de la observación del contexto en el que se comparte.

Es decir, además de emplear análisis con herramientas de detección, buscar detalles en el sonido y pedir el apoyo de especialistas en la materia; además, es necesario identificar qué narrativa reproduce, quién comenzó la difusión del material y a quién beneficia que se haga viral.

¿Qué es la inteligencia artificial?

La inteligencia artificial o IA puede definirse como un área de la informática “que lo que busca es crear sistemas que puedan realizar actividades que generalmente solo eran atribuidas a los humanos, pero que ahora se pueden hacer a través de estos sistemas”, según nos dijo Paul Aguilar coordinador de seguridad digital en socialTIC, una organización sin fines de lucro que se dedicada a la investigación y formación de la tecnología digital para fines sociales.

Existen diferentes tipos de IA, pero la que se utiliza para crear contenido como fotos, imágenes, texto o audio es la inteligencia artificial generativa. Esta tecnología permite crear este tipo de contenido con modelos que le permiten aprender o copiar un conjunto de datos de un contenido creado por personas. Es decir, la IA copia o imita algo que un ser humano ya había hecho. Hablar, por ejemplo.

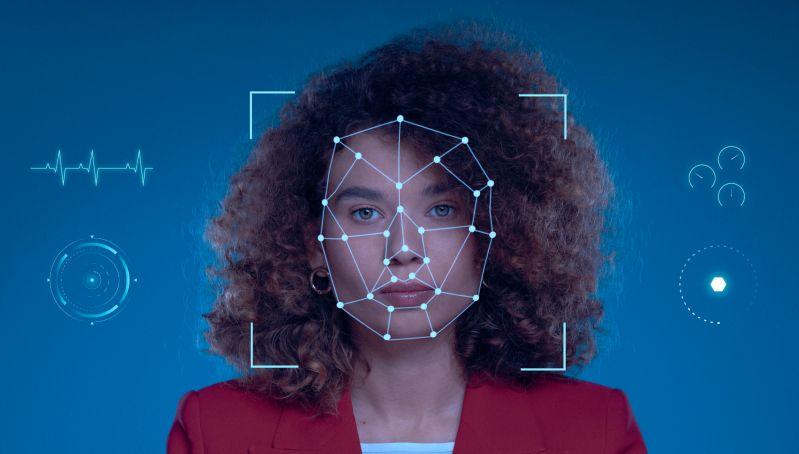

Los audios deepfakes son precisamente audios muy similares o idénticos a la voz de una persona y que se pueden generar porque se entrenó un sistema de inteligencia artificial para clonar o aprender la voz de una persona.

Entonces, en palabras de Paul Aguilar, cuando hablamos de inteligencia artificial y de audios deepfakes nos referimos a “sistemas que aprenden a imitar la voz de una persona para poder generar audios a partir de de esta imitación”.

¿Cómo se hace un audio falso?

Lo primero que tenemos que saber es que se puede usar IA para crear audios desde cero, o para modificar audios reales, según explicó a El Sabueso Manel Terraza.

Él explica que para clonar una voz, sin consentimiento, basta con tomar muestras de audios de la persona y pasarlos por un software capaz de imitar la voz y decir lo que se le pida.

“Este es el problema principal de riesgo en el mundo de la desinformación porque cualquiera puede ir y tomar el audio de un video de un político y hacer un clon de una voz”, advierte Terraza, quien agrega que existen modelos de IA con los que se puede hacer pasar la voz de una persona como si fuera de otra en tiempo real. Es decir, puede clonarse una voz mientras se sostiene una conversación.

Tal y como le sucedió en 2019 al director de una empresa de energía en Reino Unido. El ejecutivo recibió una llamada de quien pensó era un directivo de la misma compañía que le pidió transferir 243 mil dólares, se hizo la transferencia según lo indicado pero resultó ser un plan para estafar a la empresa mediante el uso de IA.

De hecho, Terraza señala que hoy en día hay muchas herramientas para clonar voz sin necesidad de tener ningún tipo de habilidad técnica. “Tan fácil como entramos en Facebook. Y esa facilidad es el punto principal por el cual existe un riesgo tan grande de que se use de forma fraudulenta”, señala.

O tan sencillo como navegar por TikTok, donde creadores de contenido muestran una y otra vez cómo crear audios con Inteligencia artificial y hasta un paso a paso de cómo el creador de FlowGPT clona las voces de los artistas como Bad Bunny para crear álbumes completos con Inteligencia Artificial.

Nosotros, por ejemplo, encontramos una app que invita a los usuarios a crear audios para imitar a sus personajes favoritos por tarifas desde 120 pesos (7 dólares) al mes. En algunos de esos modelos se puede solicitar que la voz reproduzca una emoción como felicidad o enojo, e incluso se cuenta con todo un catálogo que va desde caricaturas hasta youtubers.

Eleven Labs por su parte tiene una herramienta para generar audios de cualquier texto que se le indique, usando un enorme catálogo de voces que incluye una “dulce joven británica”, un “hombre autoritario de mediana edad” y una “mujer entusiasta con acento hindú”. Esta tecnología también puede clonar voces y traducirlas.

¿Cómo identificar deepfakes?

Paul Aguilar señala que el nivel de precisión, o de qué tan idénticos o similares son estos audios, va a depender del tipo de tecnología con el que se creó. Por lo que, en algunos casos, todavía se pueden detectar ciertas anomalías dentro de la voz.

Por ejemplo, algunos tonos no corresponden a cómo la persona pronunciaría ciertas palabras, o la congruencia o el nivel de dicción que tiene el audio creado no suena exactamente igual a cómo lo haría la persona real.

“Entonces se puede de alguna manera identificar o llegar a sospecharse que estos audios pudieran ser falsos, pero pues las herramientas están avanzando lo suficientemente rápido como para generar audios más reales o más cercanos a la voz de de una persona”, y por lo tanto más difícil de identificar.

Manel Terraza coincide, pues dice que los modelos más avanzados de síntesis de voz te permiten replicar respiraciones y pausas como las que tiene la persona que queremos imitar. Así que a medida que se van sofisticando las voces sintéticas esas diferencias son menos obvias.

“Al día de hoy prácticamente es imposible diferenciar para una persona una voz sintética buena de una real, y por lo tanto el problema de la detección es cada vez más complejo y requiere también de tecnología”, señala Terraza.

El especialista también explica que las tecnologías de detección lo que hacen es dar una probabilidad de que ese audio sea natural o creado con IA, pero su efectividad también depende de aspectos como el volumen, la duración, y qué tanto ruido ambiental hay. Por lo que siempre habrá posibilidad de que el resultado no sea correcto.

Terraza señala con el perfeccionamiento de este tipo de tecnología de generación de contenido, la única forma de tener una aproximación de si algo es real o es clonado es utilizando herramientas de detección basadas en inteligencia artificial es decir, “luchar con las mismas armas”.

¿Qué herramientas existen para identificar audios?

Existen proyectos como AntiFake, que buscan prevenir la generación de deepfakes usando IA para modificar los audios – sin afectar como lo escuchamos los humanos– y que estos no puedan ser imitados por otras IA.

También nos encontramos con una herramienta gratuita de ElevenLabs que precisamente busca tratar de ayudar a los usuarios a identificar los audios creados con IA, especialmente los que fueron generados con su misma tecnología.

Como ya mencionamos, otra de las herramientas que hemos encontrado es AI Voice Detector, pero es de paga. Al igual que el nuevo desarrollo de Loccus.ia.

Probamos estas últimas tres con un audio generado a partir de un texto con la herramienta de ElevenLabs, una grabación de mi propia voz, y el audio que se le atribuyó a Batres, aunque él lo negó.

Tanto ElevenLabs como Loccus acertaron a determinar que la grabación hecha con mi propia voz era una voz humana. Pero AI Voice Detector se equivocó, y señaló que había 55% de probabilidad de que fuera hecha con IA.

En el caso del audio que creamos con IA, las tres herramientas detectaron que se trataba de un audio fabricado.

En el caso del audio viral que se atribuyó a Batres –del que no tenemos certeza de su origen– ElevenLabs determinó un 98% de probabilidades de que fuera hecho con IA; AI Voice Detector señaló un porcentaje de entre 26 y 70% creado con IA; mientras que Loccus determinó un porcentaje de entre 5% y 25% creado con voz natural. Es decir, más del75% de probabilidad de que fuera hecho con IA.

Entonces las tres herramientas acertaron al detectar la voy creada con IA, solo dos acertaron a identificar un audio con voz natural, y dos de tres coinciden en que el audio viral de Batres fue hecho con IA.

¿Consejos para no caer en desinformación con audios falsos?

Paul Aguilar recomienda identificar el contexto del audio para saber si corresponde a algo que la persona podría o no haber dicho. También recomienda identificar la calidad del sonido o la consistencia vocal.

La tercer recomendación de Aguilar es verificar la fuente de información para saber si quien está publicando o filtrando este audio es confiable, o alguien de quien se podría sospechar que tal vez está generando esta información o falsificándola.

Aguilar dice que hay otras técnicas más especializadas, pero poco accesibles. Pues se requieren de herramientas especializadas para ingeniería de audio en donde se hace un análisis espectral del sonido, por ejemplo.

Ante este panorama, para Terraza hay que poner en duda todo lo que no te estén diciendo cara a cara, sobre todo el contenido especialmente incendiario. Los reenvíos masivos de cosas también te pueden indicar que un audio fue creado para desestabilizar o causar polémica.

¿Existe una legislación para los deepfakes?

César Avilés, investigador del Instituto Belisario Domínguez, nos explicó que “explícitamente no existe una disposición en la legislación electoral que atiende específicamente esta problemática” de la desinformación generada con IA.

Sin embargo, el especialista señala que sí existe una regulación que sanciona las calumnias, el daño a la honorabilidad de las personas, el uso de la violencia política de género, entre otras conductas que podrían entrar en el mal aprovechamiento de esta herramienta tecnológica.

Luego del audio que Martí Matres argumentó fue creado con Inteligencia Artificial, el diputado morenista Miguel Torruco propuso una reforma al código penal para sancionar a quien use IA para generar daño o perjuicio a la imagen o reputación pública de las personas.

Avilés señala que es positivo que a partir de ello se capte la atención de las y los tomadores de decisiones para poner manos en la materia, pero es necesario no perder de vista que se trata de un fenómeno mucho más complejo que necesita una legislación transversal.

“Apenas ahorita a nivel federal el Congreso está poniendo atención en el fenómeno como tal sobre qué implica la inteligencia artificial, una tecnología sumamente disruptiva que apenas estamos conociendo sus aprovechamientos, pero también cuáles son las distorsiones y las problemáticas que podrían afectar los derechos de las personas”, advierte Avilés.

Relacionado

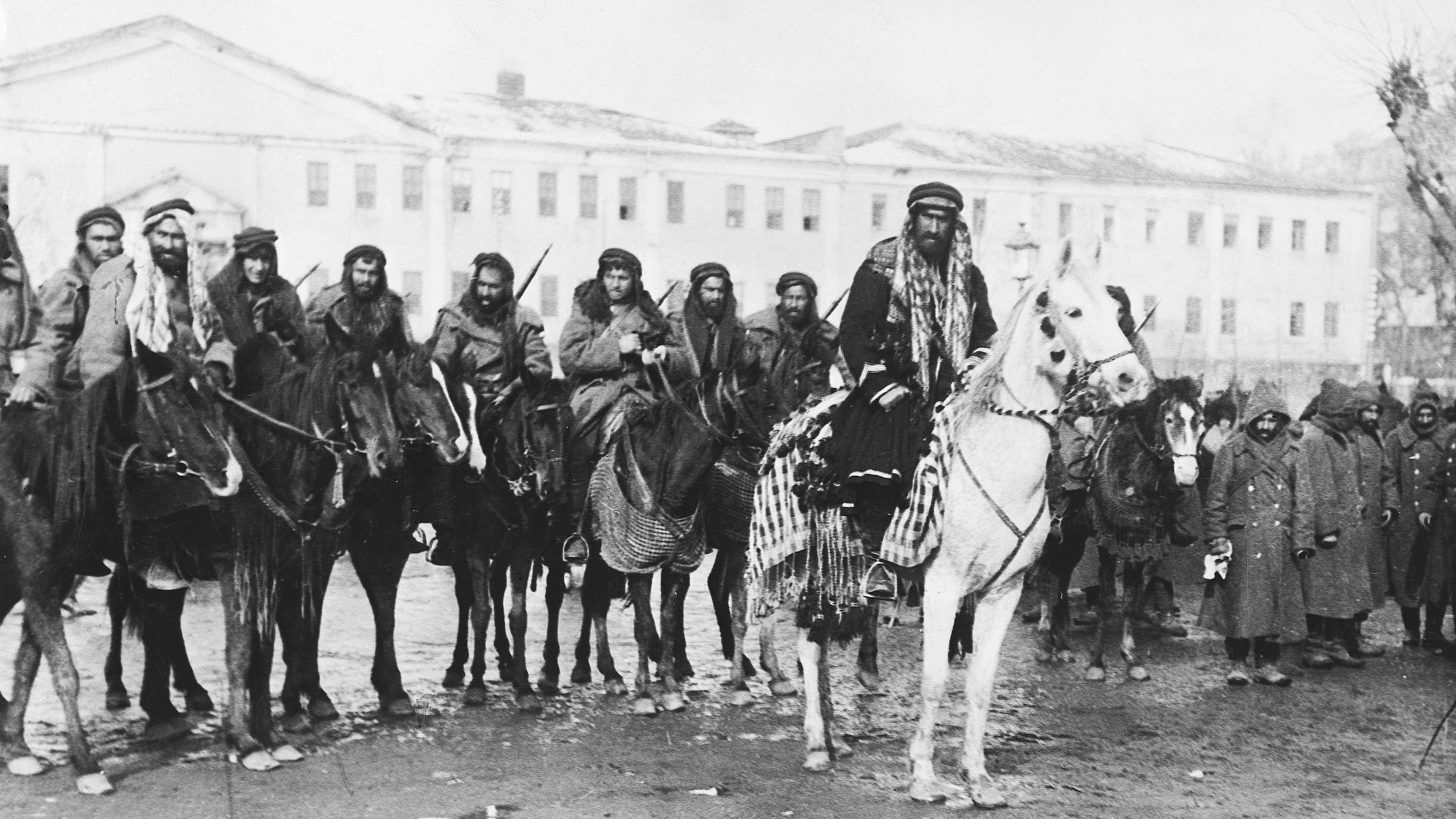

Durante décadas, el PKK ha luchado con Turquía para ganar territorio para los kurdos de Medio Oriente.

El Partido de los Trabajadores del Kurdistán (PKK) ha decidido disolverse y deponer las armas, marcando el fin de un conflicto de más de cuatro décadas con Turquía que dejó más de 40.000 muertos.

La decisión se produjo tres meses después de que su líder, Abdullah Ocalan, preso desde 1999, hiciera un llamado a la disolución del grupo.

Turquía aún no ha hecho ningún anuncio oficial, pero la disolución representaría una gran victoria para el presidente Recep Tayyip Erdogan.

También tendrá importantes repercusiones en la región, especialmente en la vecina Siria.

El grupo, de raíces izquierdistas, fue formado a finales de los años 70 y lanzó una lucha armada contra el gobierno turco en 1984, reclamando un Estado kurdo independiente dentro de Turquía.

¿Quiénes son los kurdos y por qué no tienen su propio Estado-nación?

Los kurdos son uno de los pueblos originarios de las montañas y llanuras de Mesopotamia, una región que se extiende por el sureste de Turquía, noreste de Siria, norte de Irak, noroeste de Irán y suroeste de Armenia.

Se estima que entre 25 y 35 millones de kurdos viven en esta zona. Son el cuarto grupo étnico más numeroso de Medio Oriente (después de árabes, persas y turcos), pero no tienen un Estado-nación propio.

Durante siglos, los kurdos vivieron bajo el dominio del Imperio Otomano. Cuando este colapsó al final de la Primera Guerra Mundial, muchos kurdos comenzaron a considerar la creación de una patria propia, usualmente denominada “Kurdistán”. Los aliados occidentales vencedores contemplaron esa posibilidad en el Tratado de Sèvres de 1920.

Sin embargo, este fue reemplazado en 1923 por el Tratado de Lausana, que fijó las fronteras de la Turquía moderna y no incluyó ninguna disposición para un Estado kurdo.

Los kurdos quedaron como minoría en todos los países donde habitaban. Durante los siguientes 80 años, todos los intentos kurdos por establecer un país independiente fueron reprimidos.

¿Por qué Turquía ve al PKK como una amenaza?

Los kurdos representan entre el 15 % y el 20 % de la población de Turquía.

En respuesta a los levantamientos ocurridos en las décadas de 1920 y 1930 en Turquía, muchos kurdos fueron reubicados, se prohibieron los nombres y vestimentas kurdas, se restringió el uso del idioma kurdo, e incluso se negó la existencia de una identidad étnica kurda, denominando a estas personas como “turcos de las montañas”.

En 1978, Abdullah Ocalan -un activista político de izquierda originario del sureste de Turquía- fundó el PKK, que abogaba por la creación de un Estado independiente dentro de Turquía. En 1984, el grupo inició una lucha armada.

Desde entonces, aproximadamente 40.000 personas han muerto en Turquía y en zonas de Siria e Irak cercanas a la frontera turca, como consecuencia del conflicto entre el PKK y las fuerzas de seguridad turcas. Cientos de miles de personas han sido desplazadas dentro de Turquía.

El PKK ha sido calificado como grupo terrorista en Turquía, Estados Unidos, Reino Unido y países de la Unión Europea.

¿Cuáles son las ambiciones del PKK en Turquía?

En la década de 1990, el PKK dio marcha atrás en sus demandas de un Estado independiente, y comenzó -en cambio- a pedir una mayor autonomía para los kurdos.

En una entrevista con la BBC en 2016, el líder militar del PKK, Cemil Bayik, declaró:

“No queremos separarnos de Turquía y formar un Estado. Queremos vivir dentro de las fronteras de Turquía, en nuestra propia tierra, con libertad”.

“La lucha continuará hasta que se reconozcan los derechos innatos de los kurdos”, añadió.

Sin embargo, Turquía sostiene que el PKK “intenta crear un Estado separado dentro de Turquía”.

A mediados de los años noventa, se produjeron intensos combates entre las fuerzas de seguridad turcas y el PKK. Miles de aldeas fueron destruidas en el sureste y este de Turquía -zonas de mayoría kurda-, lo que obligó a cientos de miles de kurdos a huir hacia ciudades en otras partes del país.

¿Ha intentado ya el PKK conseguir acuerdos de paz en el pasado?

El grupo pidió participar en la vida política de Turquía, mayor reconocimiento de los derechos culturales de la población kurda del país y la liberación de sus miembros encarcelados.

Turquía se negó a negociar con el PKK y ofreció únicamente una amnistía limitada a sus miembros.

Entre 2009 y 2011, el PKK y el gobierno turco mantuvieron conversaciones secretas en Noruega, pero estas fracasaron.

En marzo de 2013, Ocalan anunció un nuevo alto el fuego tras mantener diálogos con el gobierno, y pidió a las fuerzas del PKK que se retiraran de Turquía. Sin embargo, ese alto el fuego se rompió en julio de 2015.

Desde 2015, más de 7.000 personas han muerto en enfrentamientos entre las fuerzas de seguridad turcas y los combatientes del PKK en Turquía e Irak, según la organización de investigación Crisis Group.

Los combates fueron especialmente intensos en 2015 y 2016, y ocurrieron principalmente en el sureste de Turquía.

Para 2019, las fuerzas de seguridad turcas habían expulsado a muchos militantes del PKK fuera del país, y la mayor parte de los enfrentamientos se ha trasladado desde entonces a la región autónoma del Kurdistán, en el norte de Irak, y al norte de Siria.

En Siria, las tropas turcas (junto con una milicia aliada llamada Ejército Nacional Sirio) también han estado combatiendo a las Unidades de Defensa del Pueblo (YPG), lideradas por kurdos, a las que Turquía considera la rama siria del PKK.

Pero desde octubre de 2024, el gobierno turco -junto con Devlet Bahceli, líder del ultraderechista Partido del Movimiento Nacionalista- ha estado manteniendo conversaciones con el PKK, que han incluido visitas a Ocalan en la prisión de la isla de Imrali, una cárcel de alta seguridad en el mar de Mármara.

Haz clic aquí para leer más historias de BBC News Mundo.

Suscríbete aquí a nuestro nuevo newsletter para recibir cada viernes una selección de nuestro mejor contenido de la semana.

Y recuerda que puedes recibir notificaciones en nuestra app. Descarga la última versión y actívalas.

Utilizamos cookies propias y de terceros para personalizar y mejorar el uso y la experiencia de nuestros usuarios en nuestro sitio web.